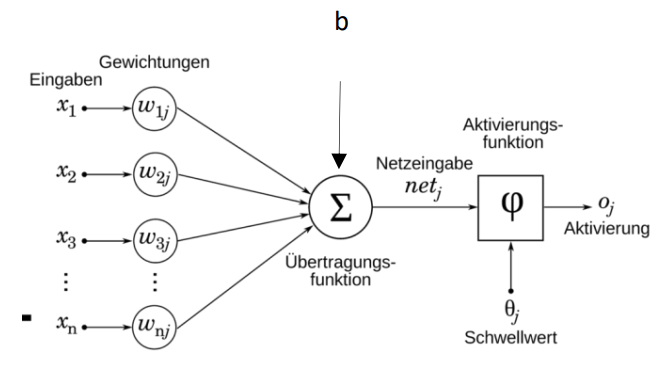

Ein einzelnes Neuron ist so aufgebaut:

Entscheidend ist hier die Aktivierungsfunktion.

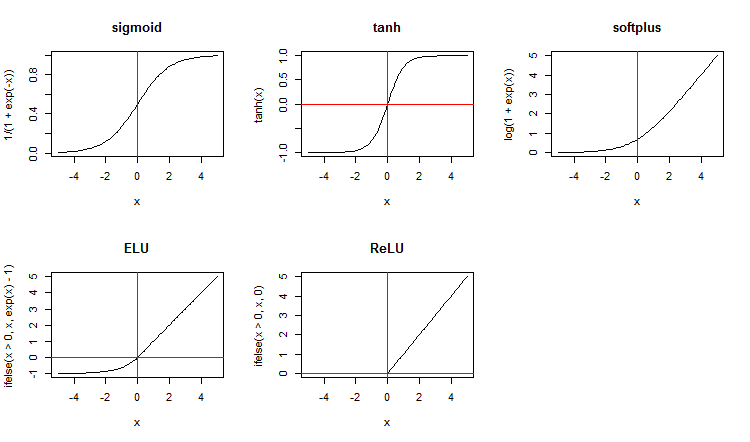

Es gibt viele verschiedene Arten der Aktivierungsfunktion:

Die ReLU Funktion hat sich in letzter Zeit bei Neuronalen Netzen etabliert.

Die ReLU Funktion hat sich in letzter Zeit bei Neuronalen Netzen etabliert.

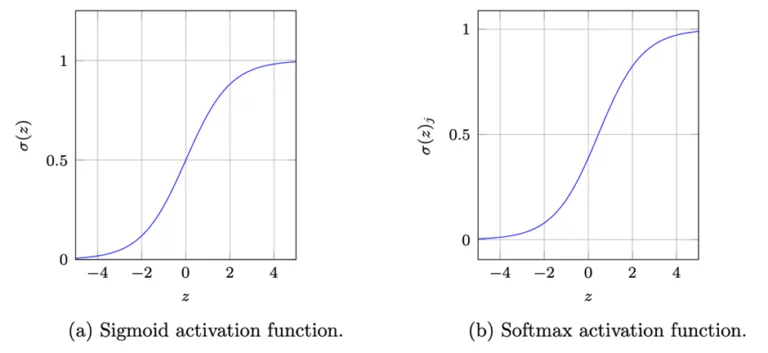

Eine zweite Funktion die häufig verwendet wird ist die Softmax activation function. Diese wird bei Klassifizierungen häufig als letzte Aktivierungsfunktion in der Ausgabeschicht benutzt. Kurzgesprochen nimmt die Softmax Funktion alle Eingangswerte und bildet daraus Wahrscheinlichkeiten.

Der Unterschied zwischen beiden Funktionen ist, dass bei der Softmax Funktion der Kurvenverlauf bei 0 noch unterhalb von 0,5 liegt.

Der Unterschied zwischen beiden Funktionen ist, dass bei der Softmax Funktion der Kurvenverlauf bei 0 noch unterhalb von 0,5 liegt.