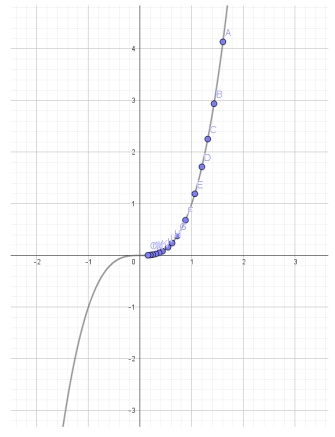

Dabei wird versucht durch Annäherung möglichst nah ein ein Minimum zu gelangen, dafür wird die Fehlerfunktion möglichst weit Reduziert:

f(x)ist die Fehlerfunktionxist der Parameter (z. B. Gewicht im Neuron)ηist die Lernrate

Wie viele Schritte wir gehen wird über den Hyperparameter Iterationen festgelegt.

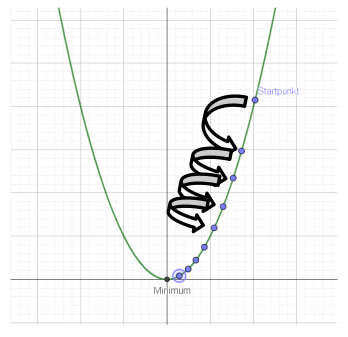

→ zu klein gewählt kommen wir nicht nah genug an das Minimum

→ zu groß gewählt kann es sein das wir über das Minimum hinaus gehen oder Rechenleistung verschwenden

In der Praxis wird meist eine Abbruchbedingung eingebaut das z. B. wenn der Fehler kleiner als ist, ist der Fehler akzeptabel

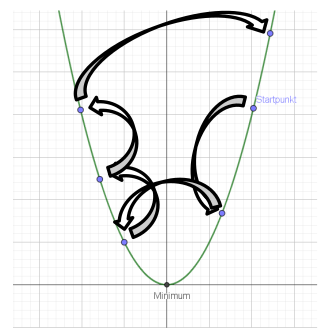

Die Lernrate () muss auch gut gewählt sein:

- ist sie zu groß kann es sein das man wieder im Graphen Aufschwingt

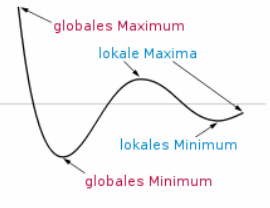

Ist er zu klein gewählt kann es sein das man über ein Lokales Minima nicht hinaus kommt und somit nie das Globale Minima erreicht.

Sattelpunkte sind für diese Algorithmen auch ein Problem. Auf Grund der abnehmenden Steigung kann es passieren das er mit einem Minima verwechselt wird.

Sattelpunkte sind für diese Algorithmen auch ein Problem. Auf Grund der abnehmenden Steigung kann es passieren das er mit einem Minima verwechselt wird.